Claude Code 被曝致命计费 Bug:Prompt Cache 失效引发成本暴涨,Anthropic 紧急回应

2026-04-01 632 0

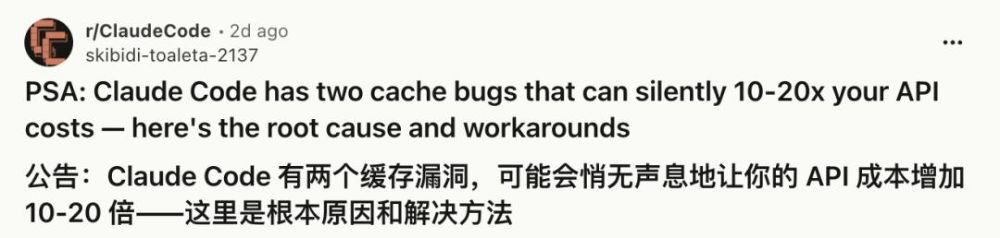

近期,围绕 AI 编程工具的争议再次升级。一位开发者在 Reddit 上公开表示,通过逆向分析 Claude Code,发现了两个相互独立但影响极大的 Bug。这两个问题会直接导致系统中的 prompt cache 机制失效,使得本应被缓存复用的上下文被重复计算,从而在用户毫无感知的情况下,大幅增加 API 调用成本。

更关键的是,这类问题并非简单的功能性 Bug,而是直接关系到用户钱包的隐形漏洞。在 AI Agent 与长上下文调用成为主流的今天,prompt cache 本质上是控制成本的核心机制之一。一旦缓存策略失效,模型每一次调用都需要重新处理完整上下文,token 消耗呈指数级增长。

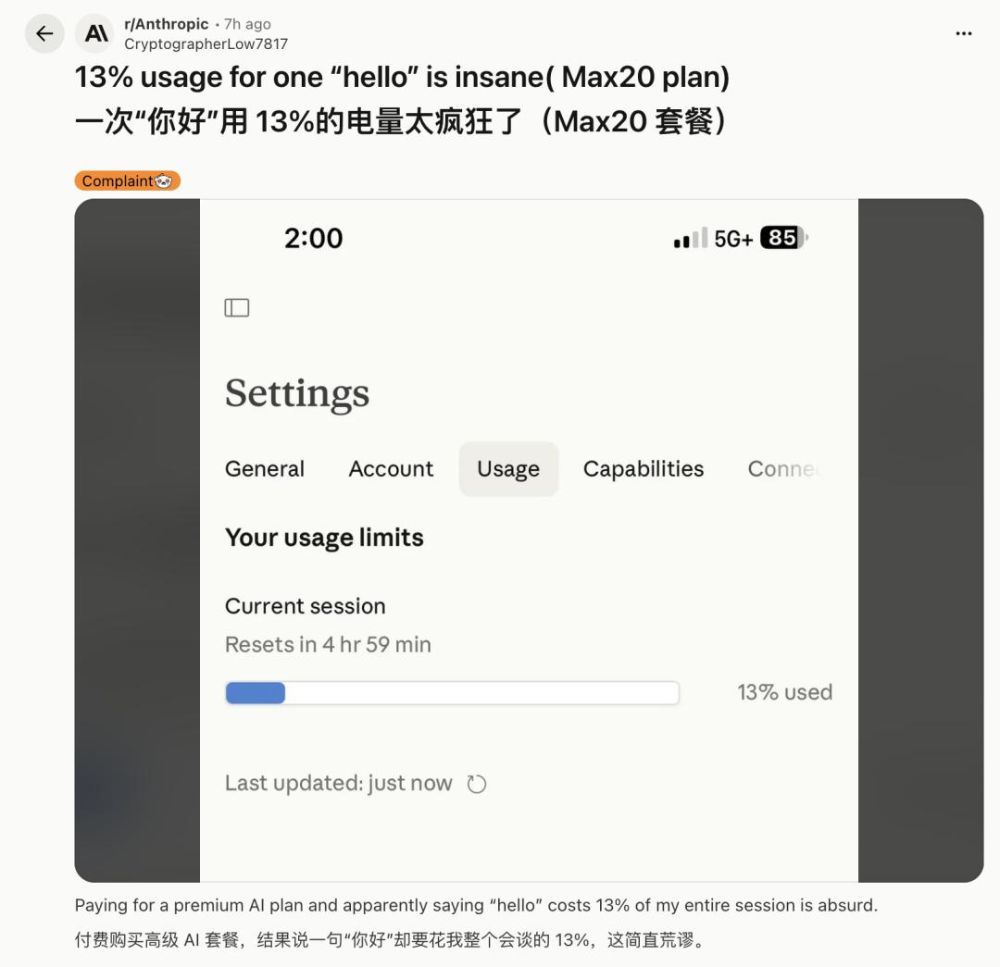

根据相关讨论,这种异常可能会让实际计费成本膨胀 10 到 20 倍。虽然用户界面没有明显提示,但账单却在悄然增加。这种无感扣费的体验迅速引发开发者社区不满,并在 Reddit 上形成了集中吐槽潮。

从技术角度来看,prompt cache 的设计初衷是通过复用稳定上下文来降低成本和延迟。研究表明,合理使用缓存可以降低 45% 至 80% 的 API 成本 。一旦缓存逻辑被破坏,不仅成本暴涨,还可能影响响应速度和系统稳定性。

与此同时,Claude Code 本身作为 Anthropic 推出的终端级 AI 编程助手,其复杂度远高于普通聊天模型。它需要处理完整代码库、多轮上下文以及工具调用,这使得系统更容易在缓存、上下文管理等环节出现边界问题。相关研究也指出,这类 AI 编程工具中超过 36% 的问题来自 API、集成或配置层面 。

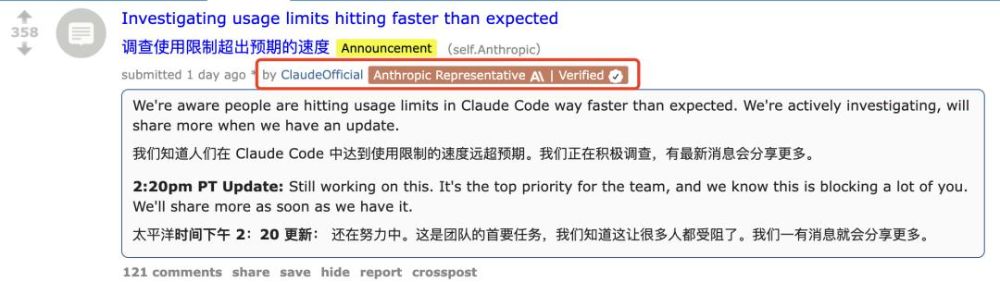

面对愈演愈烈的舆论压力,Anthropic 官方终于做出回应,承认用户触达使用上限的速度比预期快很多,并表示该问题已被列为最高优先级进行排查。虽然官方尚未明确承认具体 Bug 细节,但从措辞来看,基本确认存在异常计费或资源消耗问题。

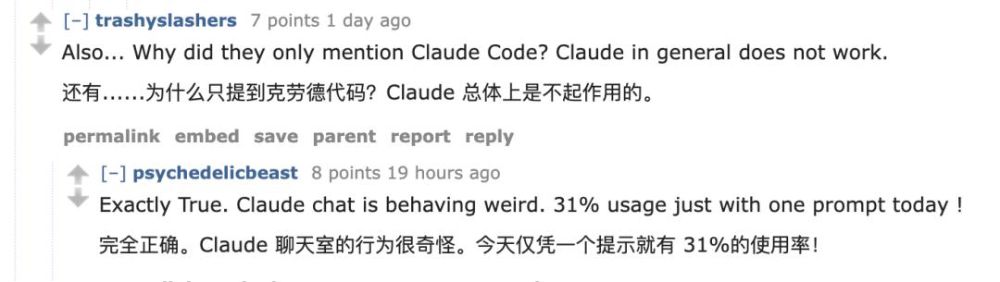

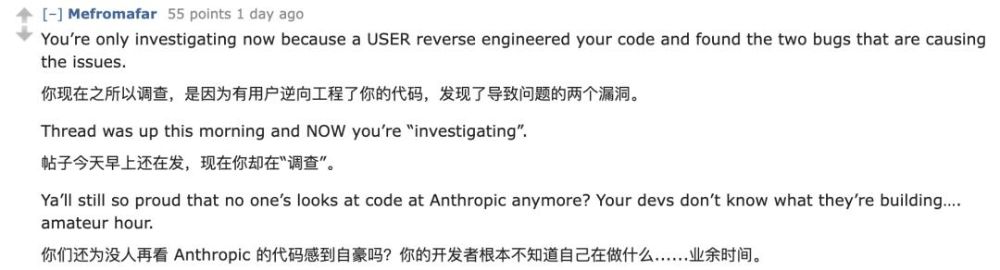

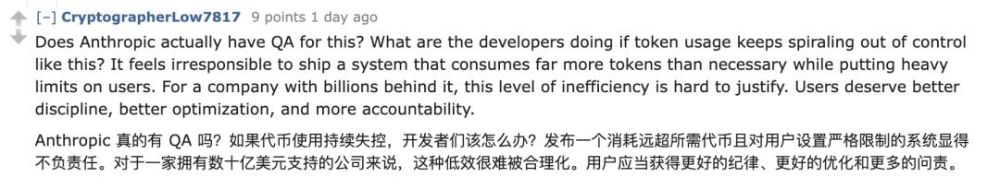

下面是Reddit社区一些网友的吐槽:

Reddit上随处可见吐槽这件事的帖子:

就在 2026 年 3 月底,Claude Code 因一次更新失误,意外泄露超过 50 万行内部源码,引发整个技术圈关注 。连续的技术事故,正在对 Anthropic 的工程能力和稳定性提出更高质疑。

相关阅读:Claude Code 源码泄漏事件解析:51万行代码裸奔,Anthropic史诗级事故

从行业视角来看,这次事件释放出几个重要信号。首先,AI 工具已经从功能竞争进入成本透明度竞争阶段。其次,随着 Agent 型应用普及,隐藏在系统内部的计费机制正变得越来越复杂,也更难被普通用户察觉。最后,开发者社区正在成为监督 AI 产品的重要力量,一旦出现问题,信息传播速度极快。

对于普通用户而言,这次事件的最大启示是:在使用 AI 编程工具时,必须关注 token 消耗、缓存命中率以及计费细节。尤其是在长上下文、多轮对话或自动化任务场景中,任何缓存异常都可能带来成倍的成本放大。

可以预见,未来一段时间内,围绕 AI 计费透明度、缓存机制以及 Agent 系统稳定性的讨论将持续升温。而 Claude Code 的这次风波,很可能只是一个开始。