使用MLC工具,在各个系统(win+linux+android等),轻松部署llama2大模型。我们可以在github上通过关键词mlc-llm找到mlc项目:

mlc-llm GitHub地址:https://github.com/mlc-ai/mlc-llm

MLC是一个通用解决方案,它可以帮助我们,将任何大语言模型,在多种硬件后端进行原生的应用程序部署。

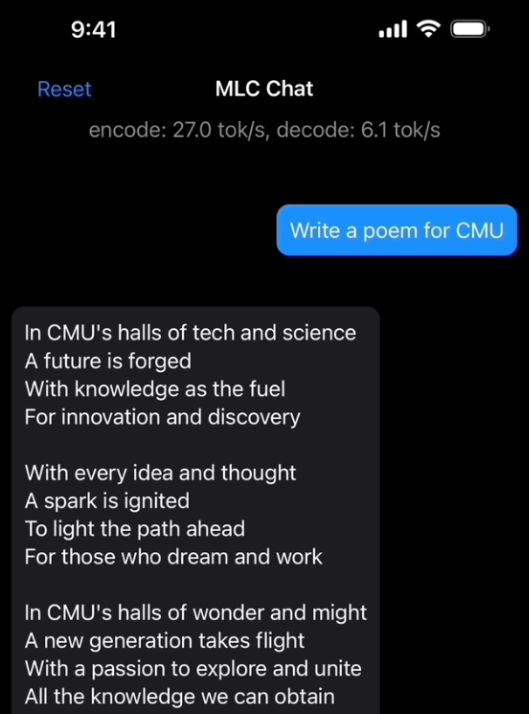

例如,图中展示了手机端部署的运行效果。

接下来,我们将在windows环境下,部署llama2-7B-chat模型,并通过mlc提供的命令行工具,对模型进行访问。在MLC的官方文档中,提供了命令行工具的安装方法。

这里我会一步一步带着大家,完成模型搭建,并对每一步命令进行解释。另外要说明是,我们需要提前安装Conda,关于Conda的安装,这里就不再过多说明了。

首先,启动conda的命令行,并输入第1行命令:

在命令中,conda create代表创建一个新的虚拟环境,使用-n指定环境的名字为mlc-chat-venv。

使用-c指定下载通道为mlc-ai和 conda-forge。

最后mlc-chat-cli-nightly,代表了我们要安装的软件名字,也就是MLC的命令行工具。

完成新环境的创建后,使用conda activate切换到这个环境:

接着使用conda install,在环境中安装git和git-lfs工具。其中git是版本控制工具,这里用来下载项目。git-lfs是Git的扩展,用于处理数据集等大文件。

完成git工具的安装后,使用git lfs install做初始化。

然后使用mkdir在当前目录创建一个放置工具的目录dist/prebuilt。

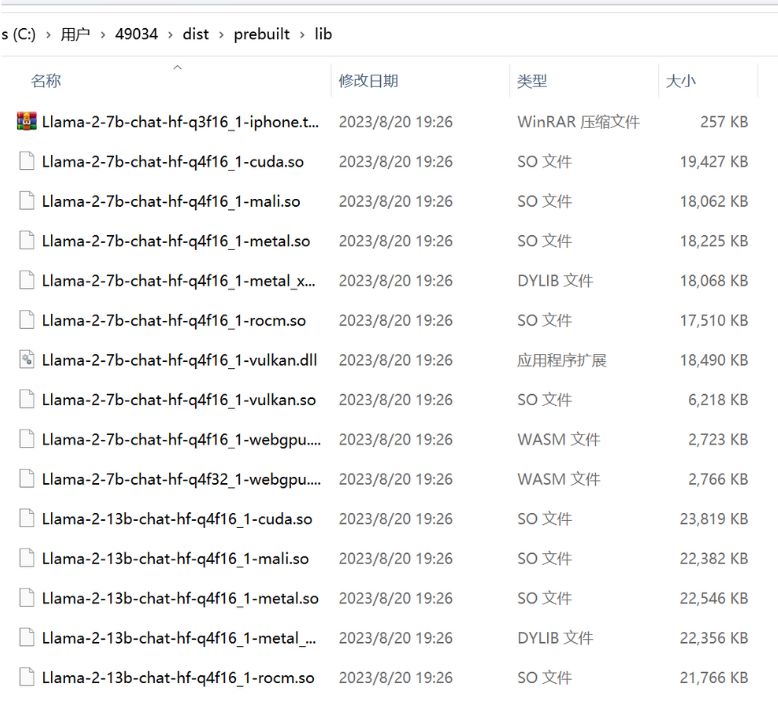

接着使用git clone,将mlc的相关libs拷贝到这个目录下。我们可以直接使用浏览器访问这个路径,可以看到在这个路径下:

保存着mlc的已经编译好的lib库。

另外,完成下载后,也可以在dist/prebuilt目录中,看到相关的文件:

然后cd打开目录dist/prebuilt,使用git clone,从huggingface上下载mlc-ai已经处理好的模型。

该模型是llama2-7b的聊天微调版本,并已经进行了量化处理。

另外,由于模型文件比较多,需要下载一阵子。

我们也可以直接访问模型对应的hugging-face页面,下载模型:

但由于模型文件过多,还是通过git clone下载模型比较方便。

完成模型的下载后,使用cd回到最开始的目录,然后使用mlc_chat_cli命令,启动并加载模型。

接着我们就可以在命令行中,与llama2模型对话了。例如,发送hello,who are you,模型会回答相应的结果。

我们还可以下载mlc提供的其他模型:

这些模型都可以通过mlc提供的工具,在本地使用。

另外,mlc也提供了python接口,帮助我们量化自己训练的模型,使用起来非常的方便。