GitHub Copilot新规:2026年起默认用你的代码和对话训练AI,开发者该如何应对?

2026-03-30 2286 0

近期,GitHub 官方宣布一项重大政策更新:自2026年4月24日起,针对 Copilot Free / Pro / Pro+ 个人用户,交互数据将默认用于AI模型训练。这一变化迅速在开发者圈引发广泛讨论。

这不仅是一项产品策略调整,更意味着AI时代数据边界的再次重塑。

政策核心:你的每一次Copilot使用都可能被学习

根据官方说明,此次调整的核心在于:

- 用户输入的提示词(Prompt)

- Copilot生成的代码与内容

- 用户修改、接受或反馈的结果

- 代码上下文、文件结构、注释等信息

这些数据都将被用于训练和优化AI模型。更关键的是:该功能默认开启(opt-out机制)。也就是说,只要你使用Copilot(个人版),你的数据就会被用于训练,除非你手动关闭。

哪些用户会被影响?哪些不会?

此次政策并非一刀切,GitHub做了明确区分:Copilot Free、Copilot Pro、Copilot Pro+的用户会被纳入训练的数据来源。Copilot Business、Copilot Enterprise、企业组织账户不会受影响。可以看出企业用户的数据保护级别明显更高。

为什么GitHub要这样做?

GitHub给出的理由其实很直接:真实世界的数据可以显著提升AI模型效果。简单来说,AI要进化,必须吃真实数据。事实上,在此之前:

- Copilot主要基于公开代码训练

- 后续已开始使用微软内部数据

- 现在进一步扩展到普通开发者

这是一条非常典型的AI发展路径:从公开数据 → 内部数据 → 用户数据。

争议点:开发者担心什么?

尽管GitHub强调符合行业惯例,但争议依然很大,主要集中在以下几点:

1. 默认开启(最核心争议)

很多开发者认为:数据使用应该是主动同意,而不是默认同意。

2. 私有代码的边界问题

虽然官方表示:静态的私有仓库内容不会被直接用于训练。但只要你在使用Copilot时涉及私有代码,这些交互仍可能被利用。

3. 数据共享问题

GitHub还提到:数据可能与微软等关联公司共享。这进一步扩大了数据使用范围。

如何关闭数据训练(强烈建议检查)

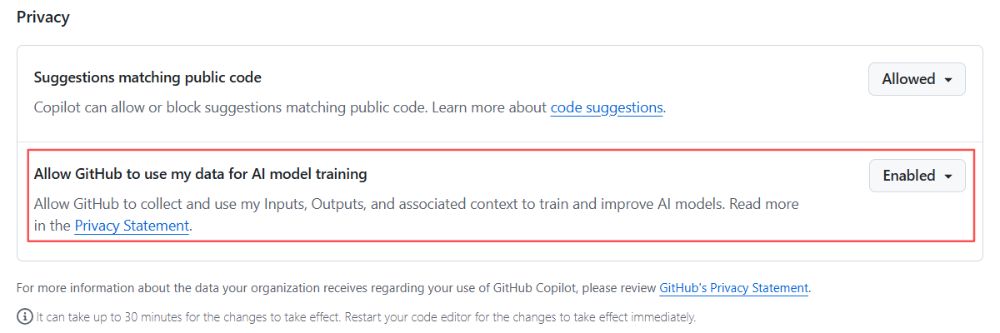

如果你不希望数据被用于训练,可以手动关闭,关闭路径如下:Copilot settings > Privacy > 关闭 Allow GitHub to use my data for AI training。已经关闭过类似选项的用户,设置会被保留。

设置页面URL:https://github.com/settings/copilot/features

这件事意味着什么?(深度解读)

这次事件,其实透露出三个重要趋势:

- AI竞争进入数据争夺战:模型能力的差距,本质上就是谁拥有更多真实用户数据。GitHub显然不愿在这场竞争中落后。

- 个人开发者正在被数据化:过去你只是用户,现在你同时是数据提供者和模型训练来源,这是一种隐性的价值转移。

- 免费工具的真实代价正在显现:Copilot Free / Pro 的本质正在变化,你不是在付费,而是在用数据支付。

开发者该如何选择?

这并不是一个非黑即白的问题,而是权衡:

- 如果你更看重效率,可以保持默认设置,享受更智能的AI辅助。

- 如果你更看重隐私,建议立即关闭数据训练,或考虑企业版(更严格的数据保护)。

GitHub这次政策更新,标志着AI开发进入一个新的阶段:从用公开数据训练AI,转向用用户行为持续训练AI。未来类似策略只会越来越多。